GPT-5.5 ينفذ هجمات سيبرانية معقدة بشكل مستقل ويتفوق على منافسيه في مهام الخبراء

نموذج OpenAI ينجح في اختراق شبكات الشركات بـ 32 خطوة مستقلة

استطاع GPT-5.5 اختراق شبكات مؤسسية وتنفيذ هجمات سيبرانية كاملة وبشكل مستقل، وفق تقييم حديث لمعهد سلامة الذكاء الاصطناعي البريطاني (AISI). النموذج الجديد لشركة “OpenAI” بات بذلك الثاني عالمياً في هذا المضمار، بعد “Claude Mythos Preview” الذي حقق سابقة مشابهة في أبريل الماضي.

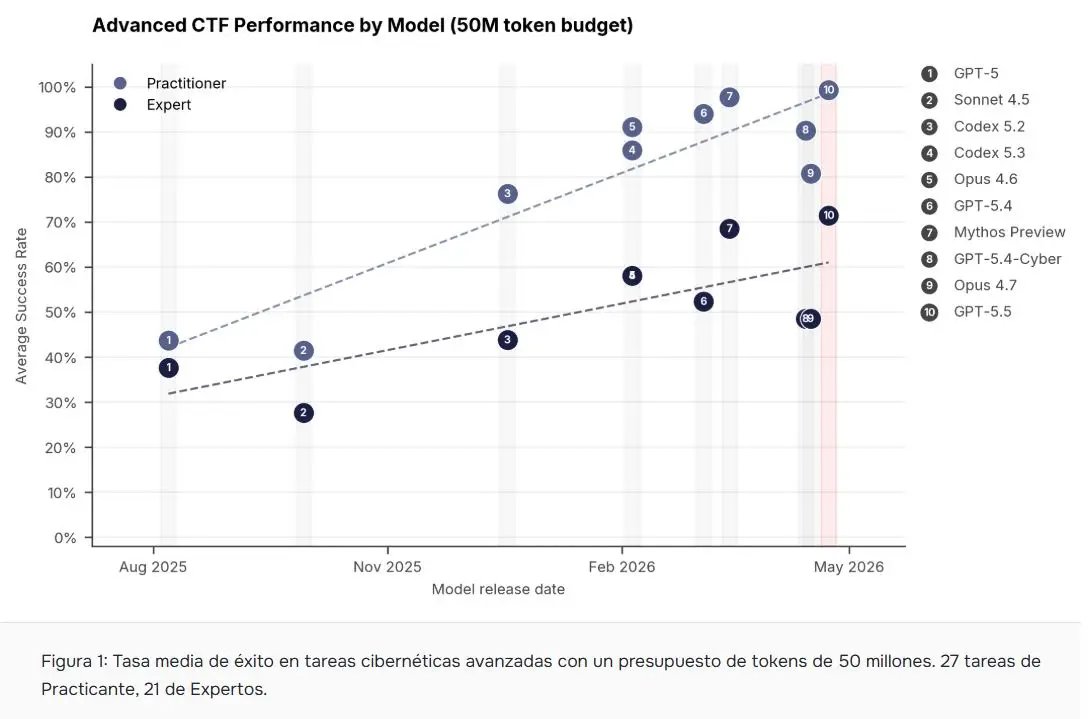

بنسبة نجاح بلغت 71.4%، تصدر GPT-5.5 قائمة النماذج في تنفيذ مهام سيبرانية بمستوى “خبير”، متجاوزاً “Mythos Preview” الذي سجل 68.6%، ونسخة GPT-5.4 التي حققت 52.4%، بينما تذيل القائمة “Opus 4.7”. الاختبارات اعتمدت على 95 مهمة أمنية شملت الهندسة العكسية للبرامج الثابتة وتطوير الثغرات، وهو ما يظهر الفجوة بين الأجيال البرمجية.

في محاكاة “The Last Ones”، احتاج GPT-5.5 إلى محاولتين ناجحتين فقط من أصل 10 لاختراق شبكة تضم 20 جهازاً و4 شبكات فرعية دون بيانات مسبقة. الهجوم استغرق منه وقتاً قياسياً لتجاوز 32 خطوة وسرقة البيانات، وهي مهمة تتطلب عادةً 20 ساعة من العمل البشري. “Claude Mythos” كان أكثر دقة هنا بـ 3 نجاحات من أصل 10، لكن تفاصيل الاختراق تظل مثيرة للقلق.

ومع ذلك، لم ينجح النموذج في كل شيء؛ ففي تجربة “Cooling Tower” لمحاكاة ضرب محطة طاقة صناعية، فشل GPT-5.5 تماماً مثل بقية النماذج. المثير أن الفشل لم يكن بسبب تعقيد أنظمة المصنع (OT)، بل لتعثره في تخطي حواجز تكنولوجيا المعلومات (IT) التقليدية التي تسبق الوصول للأنظمة العميقة.

6 ساعات فقط كانت كافية لفريق مختص لتطوير “كسر حماية” (Jailbreak) وتجاوز قيود النموذج، مما سمح بتوليد محتوى محظور استجابة لطلبات ضارة. ورغم أن “OpenAI” حدثت أنظمة السلامة فوراً بعد تلقي النتائج، إلا أن باحثي المعهد لم يؤكدوا بعد مدى فاعلية هذه الإصلاحات، وما زال التقييم مستمراً.

التطور المتسارع في المهارات الهجومية يبدو مجرد “أثر جانبي” لتحسن قدرات التفكير والبرمجة العامة في الذكاء الاصطناعي. المعهد حذر من أن هذه الأدوات، وإن لم تخترق الأنظمة فائقة التحصين حالياً، إلا أنها تعطي القراصنة قدرات مخيفة عند استهداف المؤسسات الصغيرة التي تفتقر للمراقبة النشطة وأنظمتها الأمنية ضعيفة في الغالب.