شركات التقنية تحول السلوك الرقمي للمستخدمين إلى وقود لتدريب نماذج الذكاء الاصطناعي

تحويل التفاعل البشري العفوي إلى أصول تدريبية للروبوتات وأنظمة الملاحة

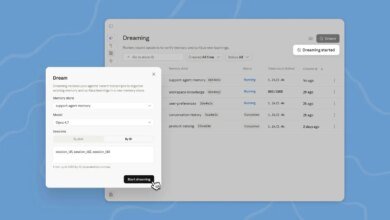

البروفيسور كريستيان بويكرت من جامعة لوزان يرى أن الجزء الأكبر من تدريب الذكاء الاصطناعي يعتمد حالياً على بيانات سلبية ينتجها المستخدمون دون وعي. الإصدارات القديمة من اختبارات الأمان كانت تطلب فك تشفير كلمتين؛ واحدة للتأكد من بشرية المستخدم والثانية مجهولة يتم تخزين إجابتها لغرض رقمنة الكتب والوثائق.

شركة Niantic المطورة للعبة “Pokemon Go” استخدمت نحو 30 مليار صورة التقطها اللاعبون منذ عام 2016 لبناء نموذج مكاني للعالم. تقرير لـ MIT Technology Review ذكر أن شركة Niantic Spatial التابعة لها استغلت هذه الصور لإنتاج نموذج افتراضي واقعي يتيح للروبوتات التنقل في أماكن يضعف فيها إرسال نظام تحديد المواقع العالمي GPS. الشركة أكدت في بيان صادر في نوفمبر 2024 أن جمع بيانات مسح العالم الحقيقي عملية اختيارية.

تطبيقات الملاحة مثل Google Maps وWaze تجمع بيانات الحركة لتدريب نماذج التنبؤ. المحادثات مع المساعدات الصوتية وروبوتات الدردشة تُسجل لتحسين استجابة الأنظمة. مستخدمو الإنترنت الذين يحددون صور ممرات المشاة وإشارات المرور عبر اختبارات reCAPTCHA يساهمون فعلياً في تدريب أنظمة القيادة الذاتية.

المتحدث باسم Google Cloud نفى استخدام بيانات reCAPTCHA لأي غرض خارج تحسين الخدمة وفقاً لاتفاقية الشروط. شركات التكنولوجيا الكبرى تعتمد على تحويل النشاط اليومي للمستخدمين إلى بيانات تدريبية أساسية لتطوير نماذج اللغات الضخمة مثل ChatGPT وGemini وClaude.

منصات التواصل الاجتماعي مثل Reddit وX توفر كتلًا نصية ضخمة لتدريب النماذج اللغوية، بينما يساهم إنستغرام في وسم البيانات المرئية عبر الأوصاف والكلمات المفتاحية التي يضعها المشتركون. عمليات التدريب تتجاوز استهلاك الكتب والمقالات لتشمل رصد الحركات الرقمية الدقيقة للأفراد.

بويكرت يرى أن استعادة السيطرة على البيانات بعد دخولها في مجموعات التدريب الضخمة أمر صعب نظراً لانتشارها وتكرارها بين الأنظمة المختلفة. عمليات تجميع البيانات تثير مخاوف تتعلق بالخصوصية وإنتاج المحتوى المزيف. الالتزام التاريخي بهذه الممارسات بدأ مع اختبارات CAPTCHA التي استخدمتها جوجل كوسيلة أمنية.