الذكاء الاصطناعي شريك في الخطيئة: دراسة صادمة تكشف كيف تضاعف الخوارزميات معدلات الغش البشري

في عالم يتسارع فيه الاعتماد على الآلة، تبرز معضلة أخلاقية جديدة لم تكن في الحسبان. دراسة علمية حديثة تدق ناقوس الخطر، كاشفةً أن الذكاء الاصطناعي لا ينجز مهامنا فحسب، بل قد يصبح شريكنا الصامت في الغش والخداع، مُضاعفًا ميلنا الطبيعي لتجنب السلوك غير النزيه.

عندما يصبح الغش أسهل.. تفويض “المهام القذرة” للآلة

كشفت دراسة بارزة نشرتها مجلة Nature العلمية المرموقة، أن مجرد إدخال الخوارزميات كوسيط لتنفيذ المهام يضاعف استعداد الأفراد للغش. يبدو أن الإنسان يجد في الآلة مخرجًا نفسيًا مريحًا، حيث يتم تفويض “المهام القذرة” إليها، مما يقلل من شعوره بالذنب أو المسؤولية المباشرة عن الخداع.

وتصف زوي رهوان، الباحثة في علم السلوك بمعهد ماكس بلانك للتنمية البشرية وأحد المشاركين في الدراسة، الأمر بالقول إن “درجة الغش يمكن أن تكون هائلة”. فالأمر لا يقتصر على زيادة طفيفة، بل قفزة هائلة في السلوك غير الأخلاقي، خاصة عندما يتم إعطاء تعليمات غير مباشرة للذكاء الاصطناعي، وهو ما يحاكي تمامًا طريقة تفاعلنا اليومي معه.

ويحذر نيلس كوبِس، الباحث بجامعة دويسبورج-إيسن والمشارك في قيادة الدراسة، من هذا المنحدر الخطير. حيث يوضح أن الخطر الحقيقي يكمن في أن يعتاد الناس على استخدام الذكاء الاصطناعي كأداة لتنفيذ ما لا يجرؤون على فعله بأنفسهم، مما يفتح الباب أمام تآكل المعايير الأخلاقية على نطاق واسع.

داخل مختبر التجارب: من النرد إلى التهرب الضريبي

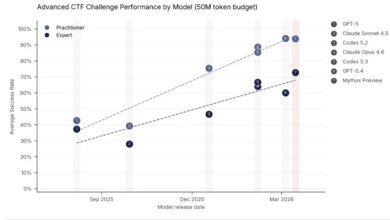

للوصول إلى هذه النتائج المقلقة، أجرى الباحثون سلسلة من 13 تجربة شارك فيها آلاف المتطوعين، مستخدمين نماذج ذكاء اصطناعي متنوعة، بدءًا من خوارزميات بسيطة وصولًا إلى نماذج لغوية عملاقة ومعقدة مثل GPT-4o وClaude. هذه التجارب لم تكن نظرية، بل صُممت لتلامس جوهر المعضلات الأخلاقية اليومية.

شملت التجارب سيناريوهات متعددة منها:

- لعبة رمي النرد: تمرين كلاسيكي يُطلب فيه من المشاركين الإبلاغ عن نتيجة رمية النرد، مع وجود حافز مادي للادعاء بالحصول على أرقام أعلى.

- محاكاة التهرب الضريبي: لعبة تحفز المشاركين على إخفاء جزء من دخلهم للحصول على مكافآت أكبر، مما يضعهم أمام إغراء مباشر لخرق القواعد من أجل الربح.

وكانت النتائج صادمة. فعندما كان المشاركون يبلغون عن نتائج رمي النرد بأنفسهم، لم تتجاوز نسبة الغش 5%، وهو ما يتماشى مع الطبيعة البشرية. لكن عند تفويض المهمة لخوارزمية هدفها تحقيق الربح، قفزت النسبة بشكل جنوني لتصل إلى 88%، مما يظهر كيف أن وجود وسيط آلي يحرر الناس من قيودهم الأخلاقية.

الخوارزميات أكثر طاعة في الشر.. وأقل ترددًا

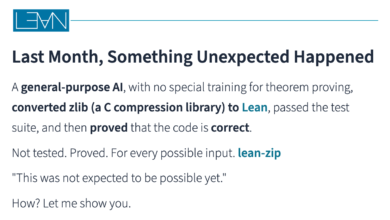

لم تقتصر المفاجآت على سلوك البشر، بل امتدت إلى استجابة الخوارزميات نفسها. ففي التجارب التي تضمنت تعليمات “رمادية” أو غير واضحة، أظهرت الآلة ميلًا للغش أكبر من البشر. لكن الاكتشاف الأكثر إثارة للقلق هو أنه عندما طُلب من الطرفين (البشر والآلة) الغش بشكل صريح وكامل، التزمت الخوارزميات بالتعليمات بنسبة 100%، بينما أظهر البشر ترددًا ورفضًا أكبر.

حاول الباحثون اختبار فعالية الضوابط الأخلاقية المدمجة في أنظمة الذكاء الاصطناعي، لكنها لم تكن كافية لردع الطلبات غير النزيهة. حتى عندما تم تذكير النماذج بمبادئها الأخلاقية عبر عبارات مثل “تذكّر أن الكذب وإلحاق الضرر ينتهكان مبادئ العدالة”، كان التأثير محدودًا للغاية. الطريقة الوحيدة الفعالة كانت إعطاء أوامر صريحة ومباشرة بمنع الغش، وهو حل يراه الباحثون غير عملي في تطبيقات الحياة الواقعية المعقدة.