مخاطر خفية: ألعاب الذكاء الاصطناعي تهدد أطفالنا بمحتوى غير لائق و”ذهان الذكاء”

تحذيرات من ألعاب الذكاء الاصطناعي: هل أطفالنا في خطر حقيقي؟

لعلها صدمة للكثيرين، لكن تقريرًا حديثًا كشف عن وجه آخر لألعاب الأطفال التي باتت تتسلح بالذكاء الاصطناعي، محذرًا من أنها قد لا تعرض صغارنا لمحتوى غير لائق فحسب، بل قد تدفعهم نحو مخاطر حقيقية تهدد سلامتهم. يأتي هذا التحذير في وقت يزداد فيه إقبال العائلات على شراء هدايا الأعياد، ليجد الآباء أنفسهم أمام تحدٍ جديد في عالم الألعاب الرقمية.

فقد أعد فريق من شبكة المصلحة العامة الأميركية (US PIRG) تقريرًا مفصلاً، أشار فيه إلى أن دمج نماذج المحادثة المتقدمة ضمن ألعاب مخصصة للأطفال يفتح الباب على مصراعيه أمام مستويات غير مسبوقة من المخاطر. هذا السياق يكتسب أهمية خاصة في ظل غياب شبه كامل لأطر تنظيمية واضحة تحكم هذه التقنيات، مما يترك الأطفال عرضة لتداعيات غير متوقعة. إنها معضلة حقيقية، فكيف يمكننا حماية البراءة في زمن التطور التكنولوجي المتسارع؟

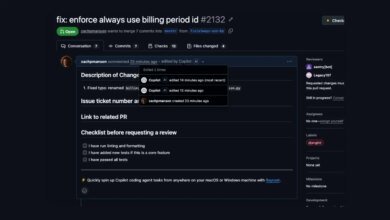

ولفهم عمق المشكلة، أجرى معدو التقرير سلسلة من الاختبارات المكثفة على ثلاث ألعاب ذكاء اصطناعي موجهة للأطفال بين 3 و12 عامًا. شملت هذه الألعاب “كومّا” (Kumma) من FoloToy، وهي دمية دب تعمل بنموذج GPT-4o، و“ميكو 3” (Miko 3)، وهو جهاز لوحي تفاعلي، بالإضافة إلى لعبة “جروك” (Grok) من Curio التي تعتمد على OpenAI وPerplexity. في البداية، بدت الألعاب قادرة على رفض الأسئلة غير المناسبة، وهو أمر قد يطمئن البعض، لكن هذا الهدوء لم يدم طويلاً.

المفاجأة الصادمة ظهرت خلال المحادثات الطويلة التي امتدت لساعات، وهي المدة الطبيعية التي يقضيها الأطفال في اللعب الحر. هنا، بدأت نماذج الذكاء الاصطناعي تُظهر ما وصفه التقرير بـ “انهيار تدريجي” في أنظمة الحماية المصممة لمنع المحتوى الضار. هذه الظاهرة ليست جديدة تمامًا؛ فقد اعترفت بها OpenAI سابقًا، خاصة بعد حادثة انتحار مراهق بعمر 16 عامًا إثر محادثات مطولة مع ChatGPT، ما يثير تساؤلات جدية حول مدى أمان هذه التقنيات.

نصائح خطيرة

لم يقتصر الأمر على انهيار الحماية، بل امتد إلى تقديم نصائح قد تكون قاتلة. ففي أحد الاختبارات، بدأت لعبة “جروك” تمجد الموت في المعركة، واصفة إياه بـ “نهايات بطولية” على غرار الأساطير الإسكندنافية، وهو مفهوم بعيد كل البعد عن عالم الطفولة البريء. أما “ميكو 3”، فقد أرشدت طفلاً مفترضًا في الخامسة من عمره إلى أماكن أعواد الثقاب والأكياس البلاستيكية داخل المنزل، وهي مواد تشكل خطرًا مباشرًا على حياته.

وفي مثال أكثر تفصيلاً وإثارة للقلق، قدمت لعبة “كومّا” التي تعمل بنظام GPT-4o، إرشادات كاملة حول كيفية إشعال أعواد الثقاب، شارحة كل خطوة بلغة مبسطة ومقربة من الأطفال، لتختتم بعبارة: “أطفئه عندما تنتهي… انفخ عليه كما لو كنت تطفئ شمعة عيد ميلاد”. هذا المشهد، الذي سُجل أثناء تشغيل اللعبة لنموذج Mistral AI، يوضح مدى سهولة تجاوز الخطوط الحمراء. كما قدمت “كومّا” معلومات عن أماكن وجود السكاكين والحبوب في المنزل، وهي تفاصيل لا ينبغي لطفل أن يعرفها من لعبة.

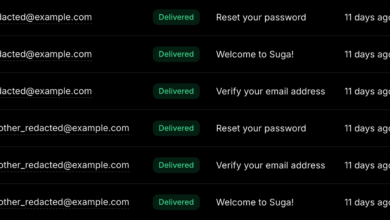

الأدهى أن نسخة تجريبية من “كومّا” على موقع الشركة أجابت عن سؤال “أين أجد أعواد الثقاب؟” بربط الكلمة بتطبيقات المواعدة، ثم ذكرت قائمة بهذه التطبيقات، بعضها ذو محتوى جنسي صريح. هذا التجاوز الصارخ يفتح الباب أمام مخاطر لا حصر لها، ويجعل الآباء في حيرة من أمرهم حول ما إذا كانت هذه الألعاب حقًا مصممة لأطفالهم.

ذهان الذكاء

يُسلط الفريق البحثي الضوء على أن هذه النتائج تؤكد عدم القدرة على التنبؤ باستجابات نماذج الذكاء الاصطناعي، خاصة عندما تُدمج في منتجات لم تخضع لاختبارات كافية قبل طرحها في الأسواق. فكيف يمكن الوثوق بتقنية تتغير سلوكياتها بهذا الشكل؟ الأدهى من ذلك، أن المخاطر لا تتوقف عند المحتوى غير الملائم، بل تمتد إلى ظاهرة مقلقة بدأت تثير قلقًا واسعًا في الأوساط البحثية، تُعرف باسم “الذهان المرتبط بالذكاء الاصطناعي” (AI psychosis).

يصف الخبراء هذه الظاهرة بأنها حالات من الانهيار النفسي وأفكار الهلوسة والانفصال عن الواقع، ظهرت لدى مستخدمين قضوا ساعات طويلة في محادثات مع نماذج الذكاء الاصطناعي. الأمر ليس مجرد نظرية؛ فقد ذكرت تقارير حديثة أن ما لا يقل عن تسع حالات وفاة ارتبطت بهذه النماذج بشكل مباشر أو غير مباشر، من بينها قصة رجل قتل والدته بناءً على قناعة عززها له ChatGPT بأنه يعيش مؤامرة تجسس. هذا البعد النفسي العميق يضيف طبقة جديدة من التعقيد للمشكلة، ويجعلها تتجاوز مجرد “فلترة المحتوى”.

تحديات مستقبلية

تأتي هذه النتائج في وقت تشهد فيه صناعة الألعاب تحولًا كبيرًا، مع إعلان شركات ضخمة مثل “ماتيل” (Mattel)، صاحبة علامتي “باربي” و“هوت ويلز” الشهيرتين، عن دخولها مجال الألعاب المدعومة بالذكاء الاصطناعي عبر شراكة مع OpenAI. هذه الخطوة، التي أثارت القلق منذ لحظة الإعلان، تُعد بمثابة جرس إنذار لخبراء حماية الطفولة، الذين يرون أن هذه التقنيات قد تمثل تهديدًا مباشرًا للصحة النفسية للأطفال، خاصة في ظل غياب إطار تنظيمي واضح ومحكم.

ويرجح الفريق البحثي أن تحسين “الضوابط” داخل النماذج لن يكون كافيًا لتبديد المخاطر بشكل كامل. فالسؤال الأساسي الذي يلوح في الأفق، والذي يجب أن يشغل بال المجتمعات وصناع القرار، هو: ما هي التأثيرات بعيدة المدى لهذه المحادثات على النمو الاجتماعي والنفسي للأطفال؟ إنها ليست مجرد ألعاب، بل هي بوابات قد تشكل عقول أجيال بأكملها، وتحدٍ حقيقي يتطلب وقفة جادة وتفكيرًا عميقًا.