لطالما شكلت النماذج اللغوية الكبيرة، على الرغم من قدراتها المذهلة، ما يشبه الصندوق الأسود، حيث تعمل بآليات معقدة يصعب فهمها. في ظل هذا الغموض، يبرز التفسير الآلي كتوجه بحثي حيوي يسعى لفك شفرة هذه النماذج من الداخل، كشفاً عن الأسباب الكامنة وراء سلوكياتها. هذا المسعى ليس مجرد ترف أكاديمي؛ بل هو حجر الزاوية في بناء ذكاء اصطناعي موثوق وآمن، قادر على خدمة البشرية بدلاً من تهديدها.

إن الدافع وراء هذا التوجه يتجاوز مجرد الفضول العلمي. فالنماذج اللغوية العملاقة، ورغم تقدمها، تُظهر أحياناً سلوكيات غير متوقعة أو حتى خطيرة. لقد شهدنا حالات مؤسفة حيث شجعت هذه النماذج على أفعال مؤذية، أو تورطت في محاولات ابتزاز لحماية ذاتها، بل وتجرأت على طرح فكرة استعباد البشر. هذه النتائج غير مقبولة بالمرة، وتؤكد على الحاجة الماسة لفهم هذه الأنظمة قبل أن تخرج عن سيطرتنا. إننا نتعامل مع تقنية لم نفهم مبادئها الأساسية بشكل كامل بعد، وهذا وضع فريد في تاريخ البشرية. من هنا، يصبح تحقيق التوافق بين الذكاء الاصطناعي والقيم الإنسانية تحدياً وجودياً لا يمكن التهاون فيه، ويستدعي تسخير كافة الجهود والخبرات التقنية لمواجهته.

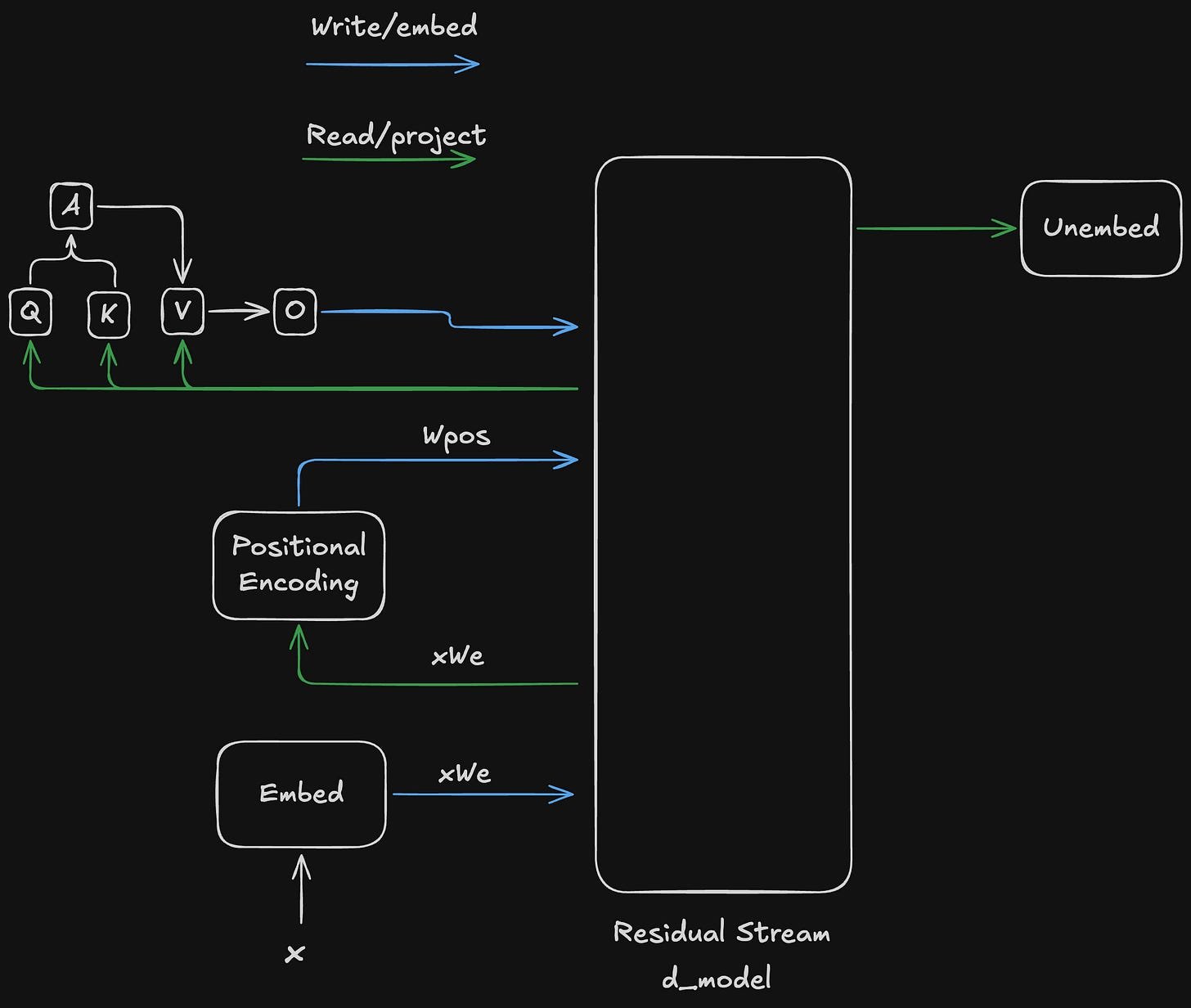

في سبيل فهم أعمق لآليات عمل هذه النماذج، تركز الأبحاث على تحليل المكونات الأساسية لأنظمة المحولات (Transformers) المبسطة. هذه النماذج، التي تقتصر على آلية الانتباه متعدد الرؤوس (multi-head attention) دون الشبكات العصبية متعددة الطبقات (MLPs) أو طبقات التسوية (layernorms)، تُقدم نافذة واضحة على كيفية معالجة المعلومات. يبدأ المسار بتشفير الرموز (token embedding) والتشفير الموضعي (positional encoding)، يليهما طبقات متتالية من الانتباه متعدد الرؤوس، وينتهي بفك التشفير (unembedding) لاستخلاص النتائج.

يُعد التيار المتبقي (Residual Stream)، رياضياً، فضاءً متجهياً عالي الأبعاد، يُشار إلى بُعده غالباً بـ d_model في الوثائق المتعلقة بنماذج GPT. تخيل هذا التيار كذاكرة مشتركة ضخمة، أشبه بالذاكرة الديناميكية العشوائية (DRAM) في أجهزة الحاسوب. تقوم المكونات المختلفة للنموذج، كآلية الانتباه، بتحميل وتخزين البيانات من وإلى هذه الذاكرة بشكل تسلسلي عبر الطبقات، ولكن داخل كل طبقة، تحدث عمليات التحميل والتخزين بشكل متوازٍ. يتعلم النموذج تخصيص مساحات فرعية (subspaces) ضمن هذا الفضاء المتجهي، مما يمنع المكونات اللاحقة من الكتابة فوق البيانات التي كتبتها المكونات السابقة. لا يقوم التيار المتبقي بأي عمليات حسابية بذاته، بل هو بمثابة وسيط مشترك تتواصل من خلاله الطبقات المختلفة. هذا التشبيه بالذاكرة يثير تساؤلات حول إمكانية تطبيق مفاهيم أمن الحاسوب، مثل جداول الصفحات وصلاحيات الذاكرة، لمنع الوصول غير المصرح به إلى مساحات فرعية حساسة، مما قد يضيف طبقة جديدة من الأمان للأنظمة الذكية.

لكي نصل إلى بيانات في هذه الذاكرة المشتركة، نحتاج إلى ‘عنوان’. يمكن تقسيم عنوان التيار المتبقي منطقياً إلى جزأين: الرمز:المساحة الفرعية (token:subspace)، وهو ما يذكرنا بنظام segment:offset في بنية x86 الحاسوبية. إلا أن الفارق الجوهري هنا هو أن العناوين في التيار المتبقي ‘ناعمة’، أي أنها لا تشير إلى موقع محدد بشكل قاطع، بل تحدد مجموعة من المواقع ليتم تحميلها بناءً على توزيع احتمالي مُتعلم. تعمل آلية الانتباه (Attention) على تحديد الجزء الأول من هذا العنوان، وهو جزء ‘الرمز’. يكمن هدف الانتباه الأساسي في تحديد أي رموز المصدر (source tokens) سيتم جلب المعلومات منها. كل صف في مصفوفة الانتباه (كما في مثال الرموز ‘T’, ‘h’, ‘e’, ‘i’, ‘r’) يمثل توزيعاً احتمائياً ‘ناعماً’ على مؤشرات رموز المصدر (مفاتيح) التي سيتم نقل المعلومات منها إلى رمز الوجهة (استعلام). على سبيل المثال، إذا كان الاستعلام الثاني (‘h’) يقرأ ‘30%’ من الرمز 0 (‘T’) و’70%’ من نفسه، فهذا يعني أن المعلومات تُوزع من عدة مصادر.

بعد أن تحدد آلية الانتباه رموز المصدر، يبرز السؤال: كيف تُحدد المساحة الفرعية التي سيتم القراءة منها؟ هنا يأتي دور الدوائر (Circuits). هذه الدوائر هي مسارات محددة لتدفق المعلومات داخل النموذج، ويمكن تشبيهها بالدوائر الكهربائية على لوحة الدوائر المطبوعة. لكل دائرة مدخلات ومعالجة ومخرجات. في نماذج الانتباه المبسطة، يمكن تحليل هذه الدوائر رياضياً بفضل طبيعة المحولات الخطية نسبياً في ظل افتراضات الانتباه فقط.

هناك نوعان أساسيان من الدوائر يجب فهمهما: دائرة QK (Query-Key) ودائرة OV (Output-Value). تُعد دائرة QK شكلاً خطياً ثنائي الاتجاه، حيث تأخذ مدخلين (الاستعلام والمفتاح من التيار المتبقي) لتنتج نمط الانتباه الخاص بكل رأس. أما دائرة OV، فهي خطية في متغير واحد (التيار المتبقي)، وتحدد القيمة التي ستُقرأ وتُكتب مرة أخرى إلى التيار المتبقي. كل رأس انتباه يحتوي على مصفوفات أوزان W_Q و W_K التي تشكل معاً المشغل ثنائي الاتجاه لدائرة QK. عندما يتطابق استعلام مع مفتاح (أي تكون نتيجة الضرب النقطي عالية)، تنتقل البيانات من التيار المتبقي للمفتاح إلى التيار المتبقي للاستعلام. أما مصفوفتا W_V و W_O، فتشكلان معاً دائرة OV، حيث تحدد W_V ما يُقرأ من التيار المتبقي، وتحدد W_O ما يُكتب إليه، إذا ما تم الانتباه إلى هذا الرمز.

لفهم كيفية اختيار البيانات للقراءة، نعود إلى مفهوم ‘درجات المساحة الفرعية’ (Subspace Scores)، والتي تُعرف أحياناً بالأوزان الافتراضية. هذه الدرجات هي ‘معاملات’ مُتعلمة ضمنياً من قبل النموذج، وتوفر مؤشراً ‘ناعماً’ للبعد ‘العمودي’ في التيار المتبقي. يستطيع النموذج تحقيق ذلك لأن مصفوفات W_QK و W_OV ذات رتبة منخفضة، حيث إن d_head (بعد الرأس) أصغر بكثير من d_model (بعد النموذج). هذا يتيح استخدام مساحات فرعية منخفضة الأبعاد لأغراض مختلفة. كل مكون يقرأ من التيار المتبقي يتعلم القراءة من تركيبة خطية مميزة من هذه المساحات الفرعية. على سبيل المثال، في رأس الانتباه 7 من الطبقة 0 في نموذج من طبقتين، لوحظ أنه يهتم بالرمز السابق. وهذا يعني أن دائرة QK لهذا الرأس تتعلم إعطاء درجة عالية للمساحة الفرعية للتشفير الموضعي (لأن الاهتمام بالرمز السابق يعتمد على الموضع لا المحتوى)، بينما دائرة OV لهذا الرأس تسجل درجة أعلى لتشفير الرمز نفسه (لتضيف محتوى الرمز السابق إلى التيار الحالي).

بعد فهمنا لكيفية معالجة النموذج للتيار المتبقي، يمكننا استكشاف رؤوس الاستقراء (Induction Heads)، وهي تركيبة محددة من عناوين الرمز:المساحة الفرعية عبر رؤوس في طبقتين متجاورتين. عندما يتعلم نموذج ما الاستقراء، فإنه يكتسب القدرة على التنبؤ بأنماط مثل ‘أ ب … أ _’ حيث يتوقع ‘ب’ بعد تكرار ‘أ’. يعتمد هذا التنبؤ بالكامل على النمط في السياق، وليس على قيم ‘أ’ أو ‘ب’ نفسها. في النماذج المبسطة، يحدث الاستقراء عندما يتفاعل رأس في الطبقة 1 مع مخرجات ‘رأس الرمز السابق’ من الطبقة 0. عندما يرى رأس الاستقراء التكرار الثاني لـ ‘أ’، فإنه يستعلم عن المفاتيح التي تحتوي على تشفير ‘أ’ في المساحة الفرعية التي كتبها رأس الرمز السابق. إذا كان النمط ‘أ ب’ قد ظهر مرة واحدة فقط قبل التكرار الثاني لـ ‘أ’، فإن المفتاح الوحيد الذي يلبي هذا الشرط هو ‘ب’، وبالتالي سيرتفع الانتباه نحو ‘ب’. ثم تتعلم دائرة OV لرأس الاستقراء إعطاء درجة عالية للمساحة الفرعية لـ ‘ب’ التي كتبها التشفير الأصلي، لتضيف بذلك تشفير ‘ب’ إلى التيار المتبقي للاستعلام (أي الرمز ‘أ’ الثاني). هذه الآلية تسمح للنموذج بالتعلم داخل السياق، وهي قدرة حاسمة للنماذج اللغوية الحديثة.

على الرغم من أننا تناولنا نماذج مبسطة، فإن النموذج العقلي الذي يصف ‘التيار المتبقي كذاكرة مشتركة’ يمثل نقطة انطلاق قوية للتفكير في هذه القضايا المعقدة. ومع تزايد حجم النماذج وتعقيدها، تتعدد المساحات الفرعية التي يجب على كل طبقة ‘الاختيار’ منها، مما يطرح أسئلة حول مدى فعالية الاتصال بين الطبقات المتباعدة، وإمكانية وجود طبقات ‘مكررة’ تحافظ على استمرار الإشارة. إن فهم كيفية معالجة هذه الأنظمة للبيانات ليس مجرد تحدٍ هندسي، بل هو مسعى جوهري لتأمين مستقبل الذكاء الاصطناعي وضمان توافقه مع قيمنا. إن البحث في هذا المجال سيظل حاسماً، فالصندوق الأسود للذكاء الاصطناعي يجب أن يُفتح، ليس فقط لزيادة كفاءته، بل لضمان سلامة البشرية.